本文只讨论以太网的物理网卡,不涉及虚拟设备,并且以一个 UDP 包的接收过程作为示例。

本示例里列出的函数调用关系来自于 kernel 3.13.0

数据包的接收

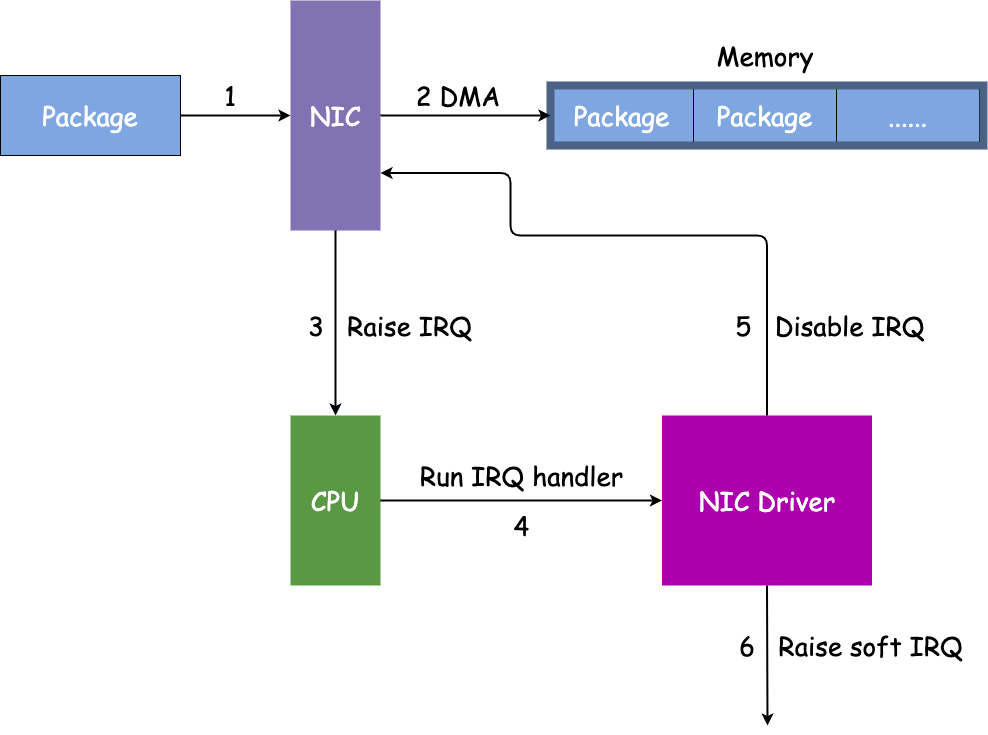

网卡到内存

网卡需要有驱动才能工作,驱动是加载到内核中的模块,负责衔接网卡和内核的网络模块,驱动在加载的时候将自己注册进网络模块,当相应的网卡收到数据包时,网络模块会调用相应的驱动程序处理数据。

- 数据包从外面的网络进入物理网卡。如果目的地址不是该网卡,且该网卡没有开启混杂模式,该包会被网卡丢弃。

- 网卡将数据包通过 DMA 的方式写入到指定的内存地址,该地址由网卡驱动分配并初始化。

- 网卡通过硬件中断(IRQ)通知 CPU,告诉它有数据来了。

- CPU 根据中断表,调用已经注册的中断函数,这个中断函数会调到驱动程序(NIC Driver)中相应的函数。

- 驱动先禁用网卡的中断,表示驱动程序已经知道内存中有数据了,告诉网卡下次再收到数据包直接写内存就可以了,不要再通知 CPU 了,这样可以提高效率,避免 CPU 不停的被中断。

- 启动软中断。这步结束后,硬件中断处理函数就结束返回了。由于硬中断处理程序执行的过程中不能被中断,所以如果它执行时间过长,会导致 CPU 没法响应其它硬件的中断,于是内核引入软中断,这样可以将硬中断处理函数中耗时的部分移到软中断处理函数里面来慢慢处理。

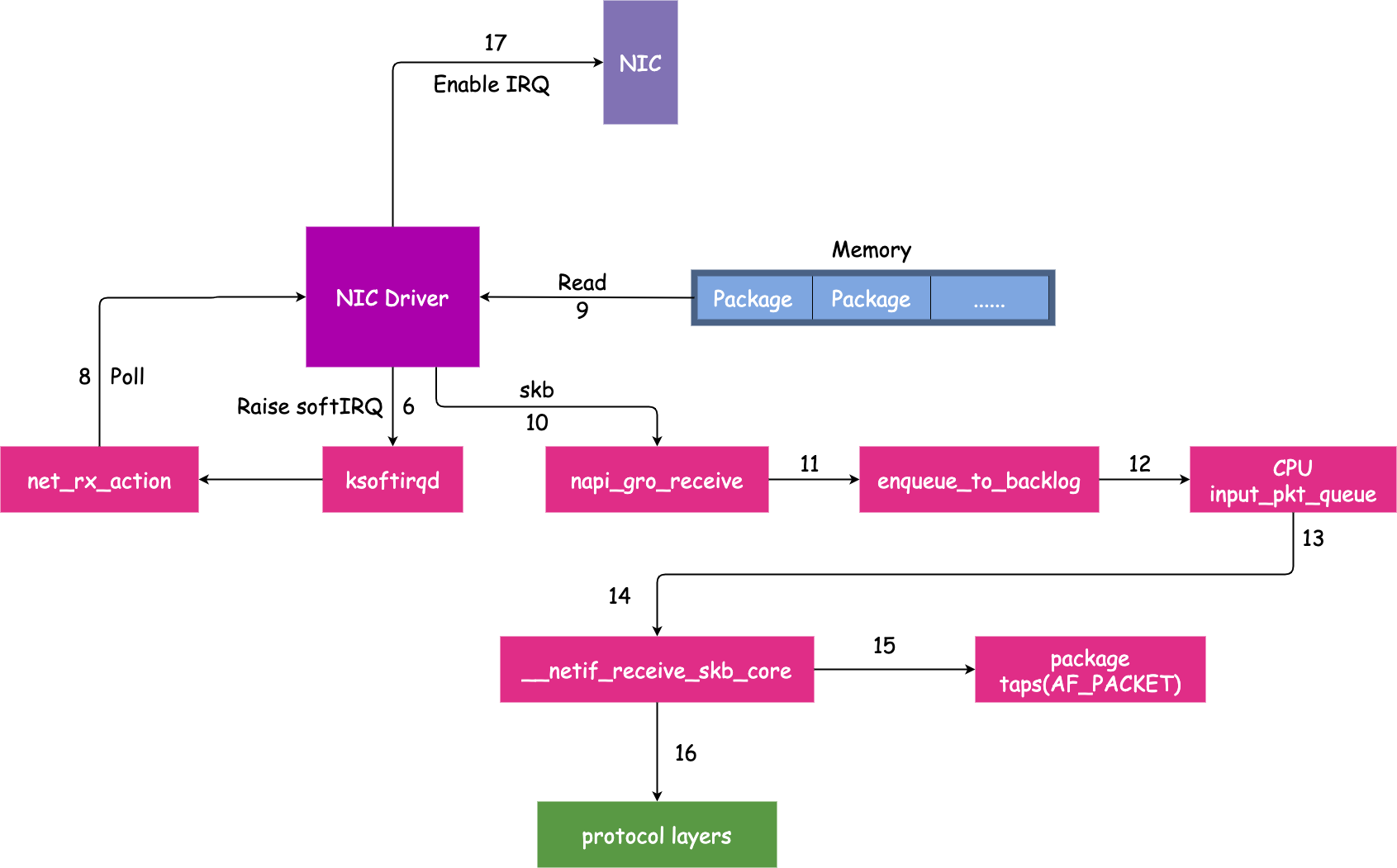

内核处理网络包

软中断会触发内核网络模块中的软中断处理函数,后续流程如下:

- 内核中的 ksoftirqd 进程专门负责软中断的处理,当它收到软中断后,就会调用相应软中断所对应的处理函数,对于上面第 6 步中是网卡驱动模块抛出的软中断,ksoftirqd 会调用网络模块的 net_rx_action 函数。

- net_rx_action 调用网卡驱动里的 poll 函数来一个一个的处理数据包。

- 在 poll 函数中,驱动会一个接一个的读取网卡写到内存中的数据包,内存中数据包的格式只有驱动知道。

- 驱动程序将内存中的数据包转换成内核网络模块能识别的 skb 格式,然后调用 napi_gro_receive 函数。

- napi_gro_receive 会处理 GRO 相关的内容,也就是将可以合并的数据包进行合并,这样就只需要调用一次协议栈。然后判断是否开启了 RPS,如果开启了,将会调用 enqueue_to_backlog。

- 在 enqueue_to_backlog 函数中,会将数据包放入 CPU 的 softnet_data 结构体的 input_pkt_queue 中,然后返回,如果 input_pkt_queue 满了的话,该数据包将会被丢弃,queue 的大小可以通过 net.core.netdev_max_backlog 来配置。

- CPU 会接着在自己的软中断上下文中处理自己 input_pkt_queue 里的网络数据(调用netif_receive_skb_core)

- 如果没开启 RPS,napi_gro_receive 会直接调用 netif_receive_skb_core

- 看是不是有 AF_PACKET 类型的 socket(也就是我们常说的原始套接字),如果有的话,拷贝一份数据给它。tcpdump 抓包就是抓的这里的包。

- 调用协议栈相应的函数,将数据包交给协议栈处理。

- 待内存中的所有数据包被处理完成后(即 poll 函数执行完成),启用网卡的硬中断,这样下次网卡再收到数据的时候就会通知 CPU

enqueue_to_backlog 函数也会被 netif_rx 函数调用,而 netif_rx 正是 lo 设备发送数据包时调用的函数。

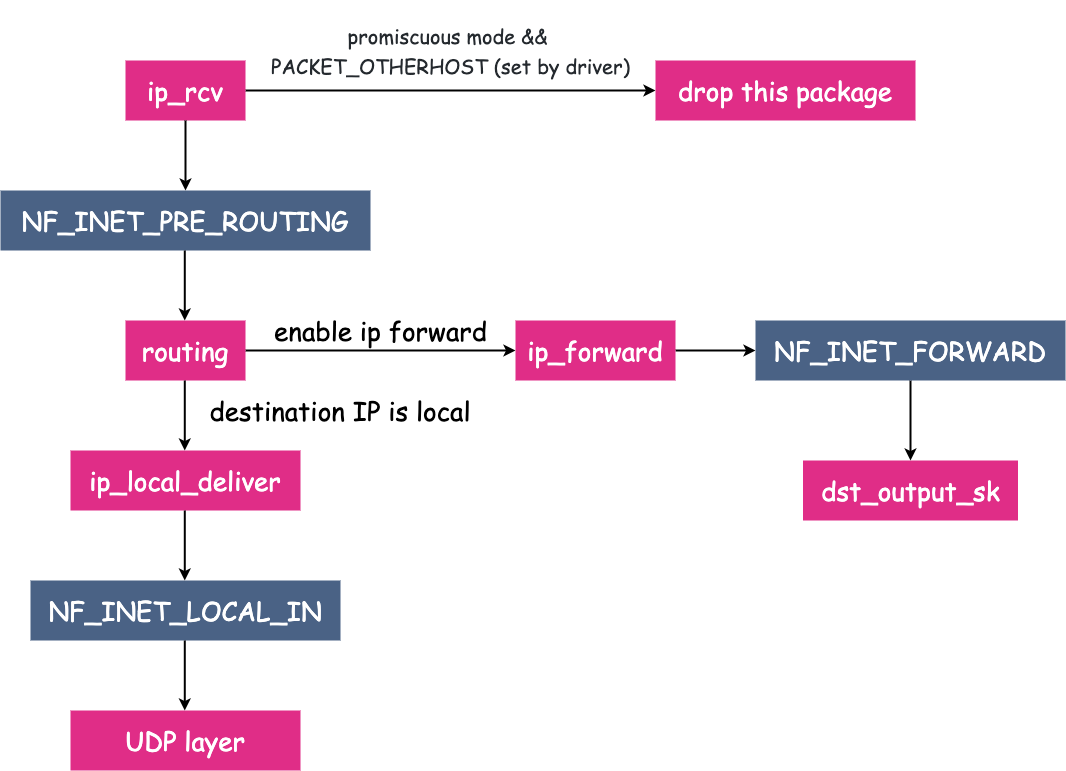

协议栈

IP 层

由于是 UDP 包,所以第一步会进入 IP 层,然后一级一级的函数往下调:

- ip_rcv: ip_rcv 函数是 IP 模块的入口函数,在该函数里面,第一件事就是将垃圾数据包(目的 mac 地址不是当前网卡,但由于网卡设置了混杂模式而被接收进来)直接丢掉,然后调用注册在 NF_INET_PRE_ROUTING 上的函数。

- NF_INET_PRE_ROUTING: netfilter 放在协议栈中的钩子,可以通过 iptables 来注入一些数据包处理函数,用来修改或者丢弃数据包,如果数据包没被丢弃,将继续往下走。

- routing: 进行路由,如果是目的 IP 不是本地IP,且没有开启 ip forward 功能,那么数据包将被丢弃,如果开启了 ip forward 功能,那将进入 ip_forward 函数

- ip_forward: ip_forward 会先调用 netfilter 注册的 NF_INET_FORWARD 相关函数,如果数据包没有被丢弃,那么将继续往后调用 dst_output_sk 函数

- dst_output_sk: 该函数会调用 IP 层的相应函数将该数据包发送出去,同下一篇要介绍的数据包发送流程的后半部分一样。

- ip_local_deliver:如果上面 routing 的时候发现目的 IP 是本地 IP,那么将会调用该函数,在该函数中,会先调用 NF_INET_LOCAL_IN 相关的钩子程序,如果通过,数据包将会向下发送到 UDP 层

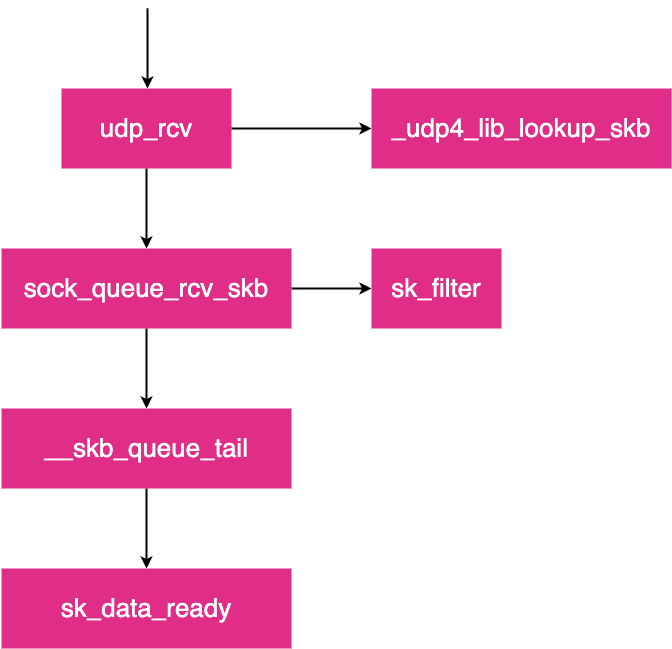

UDP层

- udp_rcv: udp_rcv 函数是 UDP 模块的入口函数,它里面会调用其它的函数,主要是做一些必要的检查,其中一个重要的调用是 __udp4_lib_lookup_skb,该函数会根据目的 IP 和端口找对应的 socket,如果没有找到相应的 socket,那么该数据包将会被丢弃,否则继续

- sock_queue_rcv_skb: 主要干了两件事,一是检查这个 socket 的 receive buffer 是不是满了,如果满了的话,丢弃该数据包,然后就是调用 sk_filter 看这个包是否是满足条件的包,如果当前 socket 上设置了 filter,且该包不满足条件的话,这个数据包也将被丢弃(在 Linux 里面,每个 socket 上都可以像 tcpdump 里面一样定义 filter,不满足条件的数据包将会被丢弃)

- __skb_queue_tail: 将数据包放入 socket 接收队列的末尾

- sk_data_ready: 通知 socket 数据包已经准备好

调用完 sk_data_ready 之后,一个数据包处理完成,等待应用层程序来读取,上面所有函数的执行过程都在软中断的上下文中。

socket

应用层一般有两种方式接收数据,一种是 recvfrom 函数阻塞在那里等着数据来,这种情况下当 socket 收到通知后,recvfrom 就会被唤醒,然后读取接收队列的数据;另一种是通过 epoll 或者 select 监听相应的 socket,当收到通知后,再调用 recvfrom 函数去读取接收队列的数据。两种情况都能正常的接收到相应的数据包。

数据包的发送

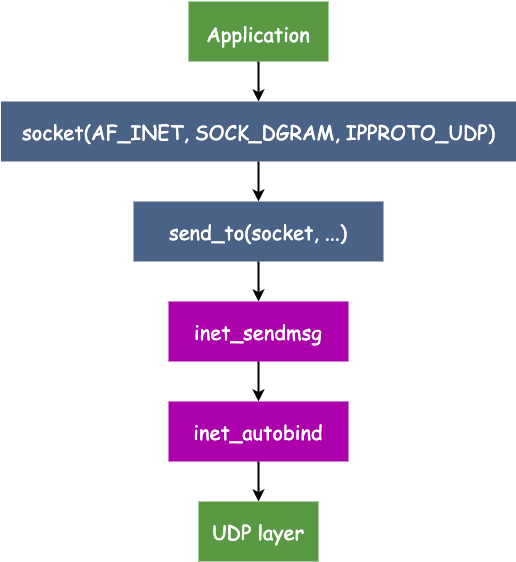

socket

- socket(…): 创建一个 socket 结构体,并初始化相应的操作函数,由于我们定义的是 UDP 的 socket,所以里面存放的都是跟 UDP 相关的函数

- sendto(sock, …): 应用层的程序(Application)调用该函数开始发送数据包,该函数数会调用后面的 inet_sendmsg

- inet_sendmsg: 该函数主要是检查当前 socket 有没有绑定源端口,如果没有的话,调用 inet_autobind 分配一个,然后调用 UDP 层的函数

- inet_autobind: 该函数会调用 socket 上绑定的 get_port 函数获取一个可用的端口,由于该 socket 是 UDP 的 socket,所以 get_port 函数会调到 UDP 代码里面的相应函数。

协议栈

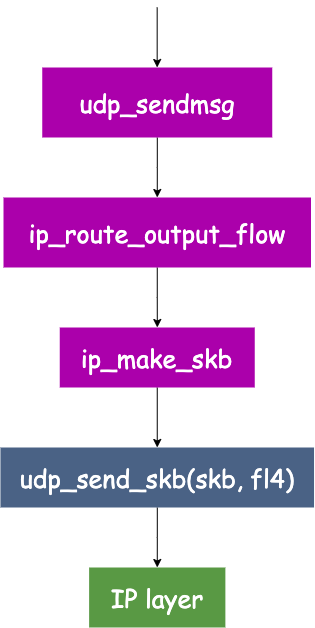

UDP层

- udp_sendmsg: udp 模块发送数据包的入口,该函数较长,在该函数中会先调用 ip_route_output_flow 获取路由信息(主要包括源 IP 和网卡),然后调用 ip_make_skb 构造 skb 结构体,最后将网卡的信息和该 skb 关联。

- ip_route_output_flow: 该函数会根据路由表和目的 IP,找到这个数据包应该从哪个设备发送出去,如果该 socket 没有绑定源 IP,该函数还会根据路由表找到一个最合适的源 IP 给它。 如果该 socket 已经绑定了源 IP,但根据路由表,从这个源 IP 对应的网卡没法到达目的地址,则该包会被丢弃,于是数据发送失败,sendto 函数将返回错误。该函数最后会将找到的设备和源 IP 塞进 flowl4 结构体并返回给 udp_sendmsg

- ip_make_skb: 该函数的功能是构造 skb 包,构造好的 skb 包里面已经分配了 IP 包头,并且初始化了部分信息(IP 包头的源 IP 就在这里被设置进去),同时该函数会调用 ip_append_dat,如果需要分片的话,会在 ip_append_data 函数中进行分片,同时还会在该函数中检查 socket 的 send buffer 是否已经用光,如果被用光的话,返回 ENOBUFS

- udp_send_skb(skb, fl4) 主要是往 skb 里面填充 UDP 的包头,同时处理 checksum,然后调用 IP 层的相应函数。

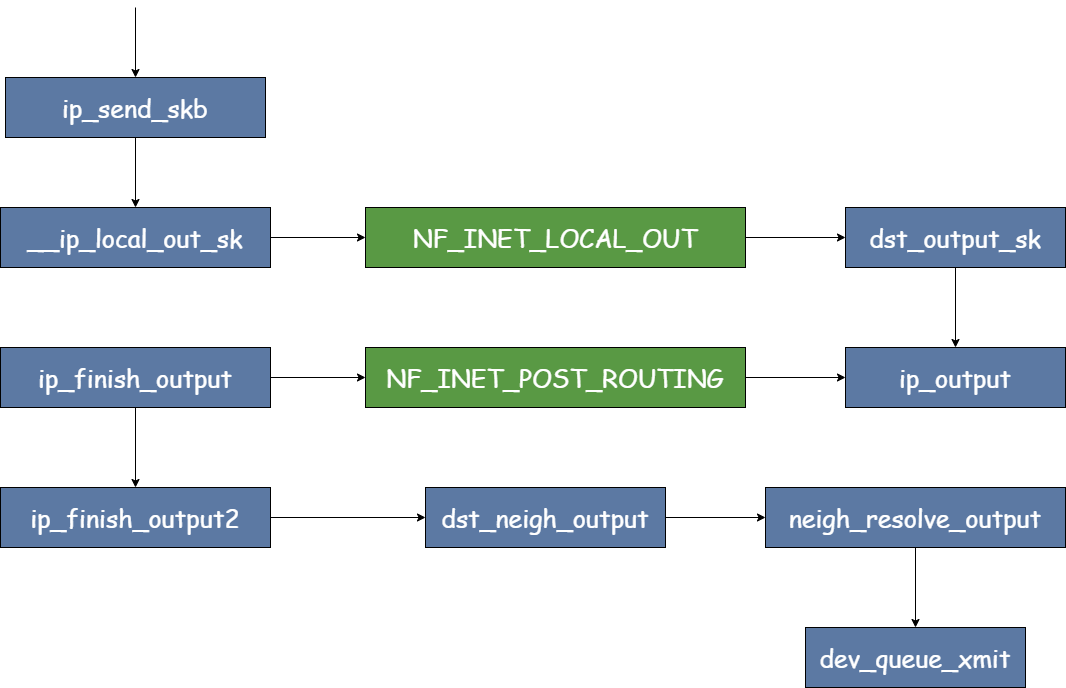

IP层

- ip_send_skb: IP 模块发送数据包的入口,该函数只是简单的调用一下后面的函数

- __ip_local_out_sk: 设置 IP 报文头的长度和 checksum,然后调用下面 netfilter 的钩子

- NF_INET_LOCAL_OUT: netfilter 的钩子,可以通过 iptables 来配置怎么处理该数据包,如果该数据包没被丢弃,则继续往下走

- dst_output_sk: 该函数根据 skb 里面的信息,调用相应的 output 函数,在我们 UDP IPv4 这种情况下,会调用ip_output

- ip_output: 将上面 udp_sendmsg 得到的网卡信息写入 skb,然后调用 NF_INET_POST_ROUTING 的钩子

- NF_INET_POST_ROUTING: 在这里,用户有可能配置了 SNAT,从而导致该 skb 的路由信息发生变化

- ip_finish_output: 这里会判断经过了上一步后,路由信息是否发生变化,如果发生变化的话,需要重新调用 dst_output_sk(重新调用这个函数时,可能就不会再走到 ip_output,而是走到被 netfilter 指定的 output 函数里,这里有可能是 xfrm4_transport_output),否则往下走

- ip_finish_output2: 根据目的IP到路由表里面找到下一跳(nexthop)的地址,然后调用 ipv4_neigh_lookup_noref 去 arp 表里面找下一跳的 neigh 信息,没找到的话会调用 neigh_create 构造一个空的 neigh 结构体

- dst_neigh_output: 在该函数中,如果上一步 ip_finish_output2 没得到 neigh 信息,那么将会走到函数 neigh_resolve_output 中,否则直接调用 neigh_hh_output,在该函数中,会将 neigh 信息里面的 mac 地址填到 skb 中,然后调用 dev_queue_xmit 发送数据包

- neigh_resolve_output: 该函数里面会发送 arp 请求,得到下一跳的 mac 地址,然后将 mac 地址填到 skb 中并调用 dev_queue_xmit

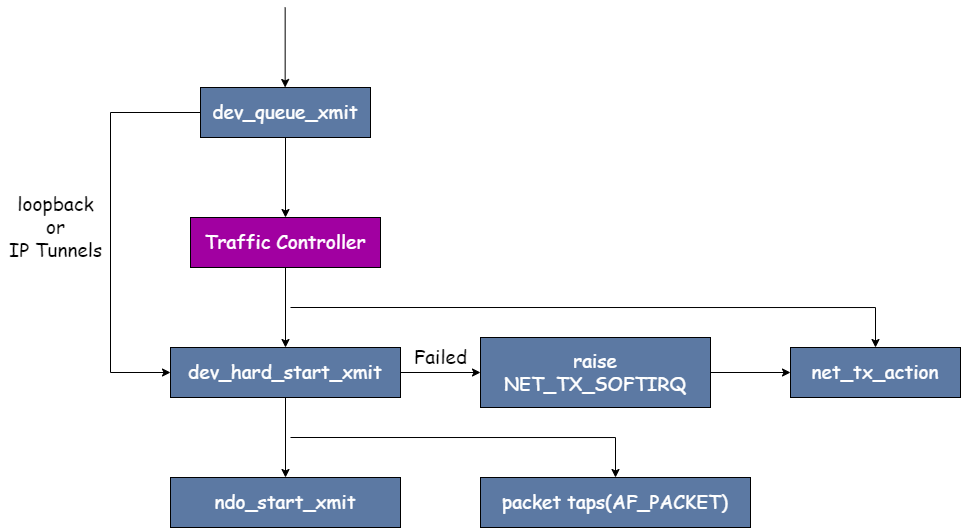

netdevice 子系统

- dev_queue_xmit: netdevice 子系统的入口函数,在该函数中,会先获取设备对应的 qdisc,如果没有的话(如 loopback 或者 IP tunnels),就直接调用 dev_hard_start_xmit,否则数据包将经过 Traffic Control 模块进行处理

- Traffic Control: 这里主要是进行一些过滤和优先级处理,在这里,如果队列满了的话,数据包会被丢掉,这步完成后也会走到 dev_hard_start_xmit

- dev_hard_start_xmit: 该函数中,首先是拷贝一份 skb 给“packet taps”,tcpdump 就是从这里得到数据的,然后调用 ndo_start_xmit。如果 dev_hard_start_xmit 返回错误的话(大部分情况可能是 NETDEV_TX_BUSY),调用它的函数会把 skb 放到一个地方,然后抛出软中断 NET_TX_SOFTIRQ,交给软中断处理程序 net_tx_action 稍后重试(如果是 loopback 或者 IP tunnels 的话,失败后不会有重试的逻辑)

- ndo_start_xmit: 这是一个函数指针,会指向具体驱动发送数据的函数

Device Driver

ndo_start_xmit 会绑定到具体网卡驱动的相应函数,到这步之后,就归网卡驱动管了,不同的网卡驱动有不同的处理方式,这里不做详细介绍,其大概流程如下:

- 将 skb 放入网卡自己的发送队列

- 通知网卡发送数据包

- 网卡发送完成后发送中断给 CPU

- 收到中断后进行 skb 的清理工作

在网卡驱动发送数据包过程中,会有一些地方需要和 netdevice 子系统打交道,比如网卡的队列满了,需要告诉上层不要再发了,等队列有空闲的时候,再通知上层接着发数据。

其它

- SO_SNDBUF: 从上面的流程中可以看出来,对于UDP来说,没有一个对应send buffer存在,SO_SNDBUF只是一个限制,当这个socket分配的skb占用的内存超过这个值的时候,会返回ENOBUFS,所以说只要不出现ENOBUFS错误,把这个值调大没有意义。从sendto函数的帮助文件里面看到这样一句话:(Normally, this does not occur in Linux. Packets are just silently dropped when a device queue overflows.)。这里的device queue应该指的是Traffic Control里面的queue,说明在linux里面,默认的SO_SNDBUF值已经够queue用了,疑问的地方是,queue的长度和个数是可以配置的,如果配置太大的话,按道理应该有可能会出现ENOBUFS的情况。

- txqueuelen: 很多地方都说这个是控制 qdisc 里 queue 的长度的,但貌似只是部分类型的 qdisc 用了该配置,如 linux 默认的 pfifo_fast。

- hardware RX: 一般网卡都有一个自己的 ring queue,这个 queue 的大小可以通过 ethtool 来配置,当驱动收到发送请求时,一般是放到这个 queue 里面,然后通知网卡发送数据,当这个 queue 满的时候,会给上层调用返回 NETDEV_TX_BUSY

- packet taps(AF_PACKET): 当第一次发送数据包和重试发送数据包时,都会经过这里,如果发生重试的情况的话,不确定 tcpdump 是否会抓到两次包,按道理应该不会,可能是我哪里没看懂